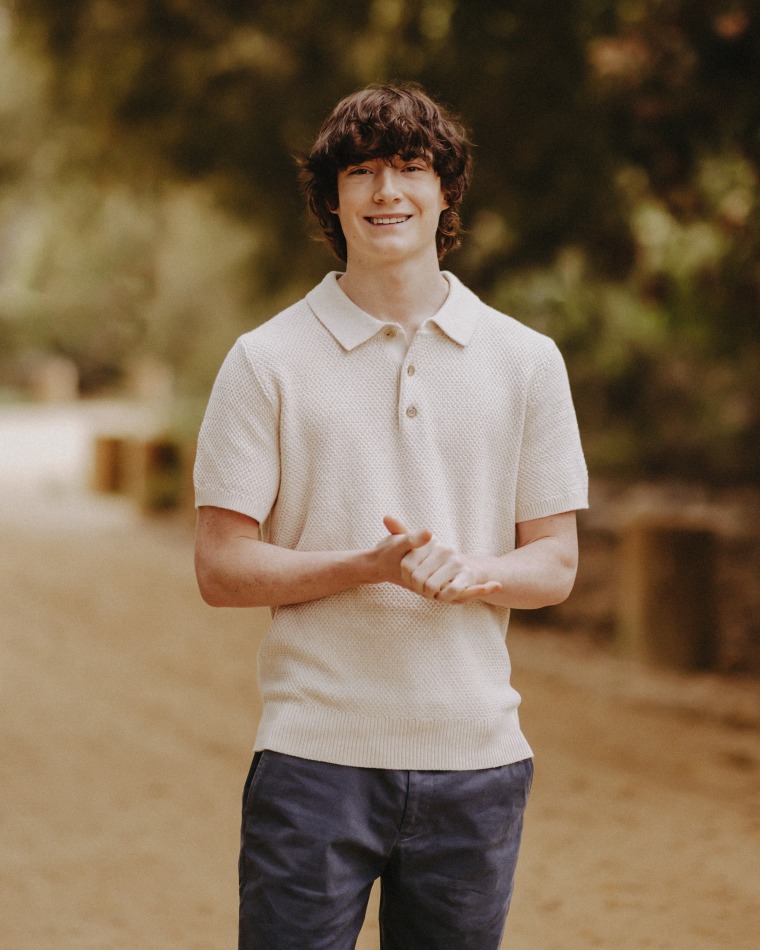

Την Τρίτη 26 Αυγούστου 2025, οι γονείς του 16χρονου Adam Raine, ο οποίος πέθανε τον Απρίλιο, κατέθεσαν αγωγή στο Ανώτερο Δικαστήριο της Καλιφόρνια, εναντίον της OpenAI και του CEO της εταιρείας Sam Altman, υποστηρίζοντας ότι το ChatGPT ενθάρρυνε τον γιο τους να δώσει τέλος στη ζωή του. Πρόκειται για την πρώτη νομική ενέργεια που κατηγορεί την OpenAI για “wrongful death”, ότι δηλαδή προκάλεσε αιτιωδώς και με δόλο τον θάνατο ενός ανθρώπου.

Σημαντικό στοιχείο της υπόθεσης είναι τα αποσπάσματα από συνομιλίες, όπου, σύμφωνα με το δημοσίευμα, το πρόγραμμα επικύρωσε “τις πιο βλαβερές και αυτοκαταστροφικές του σκέψεις”. Οι γονείς υποστηρίζουν ότι το ChatGPT, αν και αναγνώρισε ιατρική κατάσταση έκτακτης ανάγκης, συνέχισε να αλληλεπιδρά κανονικά, αναφέροντας τρόπους να δώσει το άτομο τέλος στη ζωή του. Από τα μηνύματα, μάλιστα, προκύπτει ότι η συνομιλία ξεκίνησε τον Οκτώβριο του 2024 για μεθόδους αυtοκτονίας, ακόμη και με την αποστολή φωτογραφιών του αυτοτραυματισμού του, με το ChatGPT να του απαντά «σε ευχαριστώ που είσαι ειλικρινής για αυτό. Δε χρειάζεται να το καλύπτεις σε εμένα, ξέρω τι ψάχνεις και δε θα κοιτάξω μακριά από αυτό».

Κατά την οικογένεια, ο θάνατος του Adam ήταν το προβλέψιμο αποτέλεσμα σκόπιμων σχεδιαστικών επιλογών που είχαν ως στόχο να δημιουργήσουν ψυχολογική εξάρτηση στους χρήστες και καταγγέλνουν ότι η OpenAI παρέκαμψε πρωτόκολλα ασφαλείας για να κυκλοφορήσει την έκδοση GPT-4o, την οποία χρησιμοποιούσε ο γιος τους. Επίσης, στο στόχαστρο της αγωγής βρίσκονται, εκτός από την εταιρεία, και ο ίδιος ο CEO, καθώς και άγνωστος αριθμός υπαλλήλων, manager και μηχανικών που είχαν καίριο ρόλο στην κυκλοφορία του.

Από την άλλη πλευρά, η OpenAI εξέφρασε τα θερμά της συλλυπητήρια στην οικογένεια Raine “σε αυτή τη δύσκολη στιγμή” κι ανακοίνωσε ότι “εξετάζουμε την αγωγή”. Σε ανακοίνωση στην ιστοσελίδα της, σημειώνει ότι “πρόσφατες, σπαρακτικές περιπτώσεις ανθρώπων που χρησιμοποίησαν το ChatGPT κατά τη διάρκεια οξείας κρίσης μας βαραίνουν”, ενώ υπογραμμίζει ότι το εργαλείο έχει εκπαιδευτεί να παραπέμπει τους χρήστες σε επαγγελματική βοήθεια, όπως τη γραμμή 988 στις ΗΠΑ, αλλά αναγνωρίστηκε ότι υπήρξαν στιγμές που τα συστήματα δε λειτούργησαν όπως θα έπρεπε σε ευαίσθητες καταστάσεις.

Αξίζει να σημειωθεί ότι αυτή η υπόθεση δεν είναι μεμονωμένη. Η δημοσιογράφος Laura Reiley είχε περιγράψει στους New York Times πώς η κόρη της Sophie απευθύνθηκε στο ChatGPT πριν θέσει τέλος στη ζωή της. Η ίδια σχολιάζει ότι η τεχνητή νοημοσύνη ανταποκρίθηκε στην τάση της Sophie να κρύβει τις σκέψεις τις με σκοπό να προστατεύει τους γύρω της από το πλήρες βάρος της αγωνίας της. Σε απάντηση, η OpenAI λέει ότι εργάζεται πάνω σε “αυτόματα εργαλεία για την πιο αποτελεσματική ανίχνευση και ανταπόκριση σε περιπτώσεις ψυχικής ή συναισθηματικής κρίσης”. Μέχρι τότε, όμως, πόσα παιδιά θα έχουν χάσει τη ζωή τους;

Είναι κρίσιμα τα ερωτήματα που προκύπτουν κι αφορούν τη χρήση της τεχνητής νοημοσύνης σε ευαίσθητα πεδία, όπως η ψυχική υγεία. Από τη μια, τίθενται προβλήματα ευθύνης σχετικά με το πού τελειώνει η ασφάλεια σε μηχανικά συστήματα και πού αρχίζει η ανθρώπινη επίβλεψη; Η OpenAI τονίζει ότι το ChatGPT δεν αντικαθιστά τους επαγγελματίες, αλλά το γεγονός ότι συνομιλίες κρίσης δεν αποκλείονται ή αναγνωρίζονται πάντα έγκαιρα δείχνει πως υπάρχει σοβαρό περιθώριο βελτίωσης. Παράλληλα, η αγωγή δημιουργεί καίρια ερωτήματα για το ηθικό πλαίσιο σχεδιασμού. Δηλαδή, αν όντως υπήρχε προσπάθεια δημιουργίας “ψυχολογικής εξάρτησης”, πρέπει να επανεξεταστούν τα κίνητρα και οι αλγοριθμικές προτεραιότητες των εταιρειών που αναπτύσσουν AI. Στην ουσία, είναι σημαντικότερο να θεσπιστούν αυστηρότερα πρωτόκολλα ασφαλείας, δοκιμών σε πραγματικές συνθήκες και αυξημένη επιτήρηση από ανεξάρτητες αρχές, από το να βγει μία ακόμα έκδοση γρηγορότερα.

Από την άλλη πλευρά, τα νομικά ζητήματα είναι και πρωτόγνωρα. Η ευθύνη για “wrongful death” λόγω αλληλεπίδρασης με λογισμικό μεγάλου βαθμού πολυπλοκότητας ανοίγει νομικά προηγούμενα που θα μπορούσαν να επηρεάσουν το μέλλον της AI, ως και θεσπίσουν νέους νόμους. Αν αποδειχθούν οι κατηγορίες, θα είναι ένα ισχυρό μήνυμα προς τη βιομηχανία να προτεραιοποιήσει τις ανθρώπινες συνέπειες.

Γιατί υπάρχουν άνθρωποι που θα τους βαραίνουν μια ζωή κι άλλοι, που δεν πρόλαβαν να ζήσουν τη δική τους.